Τεχνητή νοημοσύνη: Σε ισχύ ο νέος ευρωπαϊκός κανονισμός

Ο κανονσμός της ΕΕ για την τεχνητή νοημοσύνη χωρίζει τις εφαρμογές ΑΙ σε κατηγορίες επικινδυνότητας.

Σε ισχύ τίθεται σήμερα 1η Αυγούστου ο ευρωπαϊκός κανονισμός για την τεχνητή νοημοσύνης (AI Act) , ο πρώτος ολοκληρωμένος νόμος στον κόσμο για τους κινδύνους της νέας τεχνολογίας.

Ο κανονισμός έχει σχεδιαστεί για να διασφαλίζει ότι η τεχνητή νοημοσύνη που αναπτύχθηκε και χρησιμοποιείται στην ΕΕ είναι αξιόπιστη, με εγγυήσεις για την προστασία των θεμελιωδών δικαιωμάτων των ανθρώπων.

Και αποσκοπεί στη δημιουργία μιας εναρμονισμένης εσωτερικής αγοράς για την τεχνητή νοημοσύνη , ενθαρρύνοντας την υιοθέτηση της τεχνολογίας και δημιουργώντας ένα υποστηρικτικό περιβάλλον για την καινοτομία και τις επενδύσεις.

Ορισμένες χρήσεις βιομετρικών συστημάτων απαγορεύονται, για παράδειγμα συστήματα αναγνώρισης συναισθημάτων στον χώρο εργασίας.

«Σήμερα , τίθεται σε ισχύ ο νόμος περί τεχνητής νοημοσύνης. Το πρωτοποριακό πλαίσιο της Ευρώπης για καινοτόμο και ασφαλή τεχνητή νοημοσύνη», έγραψε η πρόεδρος της Ευρωπαϊκής Επιτροπής Ούρσουλα φον ντερ Λάιεν σε ανάρτησή της στο X, τονίζοντας τη σημασία της είδηση αυτής: «Θα οδηγήσει στην ανάπτυξη της τεχνητής νοημοσύνης που μπορούν να εμπιστευτούν οι Ευρωπαίοι. Και παρέχει υποστήριξη σε ευρωπαϊκές ΜΜΕ και νεοφυείς επιχειρήσεις για να φέρουν στην αγορά λύσεις τεχνολογίας αιχμής».

Today, the Artificial Intelligence Act comes into force.

Europe’s pioneering framework for innovative and safe AI.

It will drive AI development that Europeans can trust.

And provide support to European SMEs and startups to bring cutting-edge AI solutions to market. pic.twitter.com/cRoVoRtEy0

— Ursula von der Leyen (@vonderleyen) August 1, 2024

Τεχνητή νοημοσύνη

Ο νόμος για την τεχνητή νοημοσύνη εισάγει έναν μακροπρόθεσμο ορισμό της τεχνητής νοημοσύνης, με βάση μια προσέγγιση που χωρίζει τις εφαρμογές ΑΙ σε κατηγορίες επικινδυνότητας.

Ελάχιστος κίνδυνος : Τα περισσότερα συστήματα τεχνητής νοημοσύνης, όπως τα συστήματα συστάσεων με δυνατότητα τεχνητής νοημοσύνης και τα φίλτρα ανεπιθύμητης αλληλογραφίας, εμπίπτουν σε αυτήν την κατηγορία. Αυτά τα συστήματα δεν αντιμετωπίζουν υποχρεώσεις βάσει του νόμου περί τεχνητής νοημοσύνης λόγω του ελάχιστου κινδύνου για τα δικαιώματα και την ασφάλεια των πολιτών. Οι εταιρείες μπορούν να υιοθετήσουν εθελοντικά πρόσθετους κώδικες δεοντολογίας .

Ειδικός κίνδυνος διαφάνειας : Τα συστήματα τεχνητής νοημοσύνης όπως τα chatbots πρέπει να αποκαλύπτουν ξεκάθαρα στους χρήστες ότι αλληλεπιδρούν με ένα μηχάνημα . Ορισμένο περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη, συμπεριλαμβανομένων των απομιμήσεων σε βάθος, πρέπει να επισημαίνεται ως τέτοιο και οι χρήστες πρέπει να ενημερώνονται όταν χρησιμοποιούνται συστήματα βιομετρικής κατηγοριοποίησης ή αναγνώρισης συναισθημάτων. Επιπλέον, οι πάροχοι θα πρέπει να σχεδιάσουν συστήματα με τρόπο ώστε το περιεχόμενο συνθετικού ήχου, βίντεο, κειμένου και εικόνων να επισημαίνεται σε μορφή αναγνώσιμη από μηχανή και να ανιχνεύεται ως τεχνητά δημιουργημένο ή χειραγωγημένο.

Υψηλός κίνδυνος: Τα συστήματα τεχνητής νοημοσύνης που προσδιορίζονται ως υψηλού κινδύνου θα πρέπει να συμμορφώνονται με αυστηρές απαιτήσεις , συμπεριλαμβανομένων συστημάτων μετριασμού κινδύνου, υψηλής ποιότητας συνόλων δεδομένων, καταγραφής δραστηριότητας, λεπτομερούς τεκμηρίωσης, σαφείς πληροφορίες χρήστη, ανθρώπινη επίβλεψη και υψηλό επίπεδο ευρωστίας, ακρίβειας και ασφάλειας στον κυβερνοχώρο. Τα ρυθμιστικά sandbox θα διευκολύνουν την υπεύθυνη καινοτομία και την ανάπτυξη συμβατών συστημάτων AI.

Απαράδεκτος κίνδυνος: Τα συστήματα τεχνητής νοημοσύνης που θεωρούνται σαφής απειλή για τα θεμελιώδη δικαιώματα των ανθρώπων θα απαγορευθούν . Αυτό περιλαμβάνει συστήματα ή εφαρμογές τεχνητής νοημοσύνης που χειραγωγούν την ανθρώπινη συμπεριφορά για να παρακάμψουν την ελεύθερη βούληση των χρηστών, όπως παιχνίδια που χρησιμοποιούν φωνητική βοήθεια που ενθαρρύνουν την επικίνδυνη συμπεριφορά ανηλίκων, συστήματα που επιτρέπουν «κοινωνική βαθμολόγηση» από κυβερνήσεις ή εταιρείες και ορισμένες εφαρμογές προγνωστικής αστυνόμευσης.

Επιπλέον, ορισμένες χρήσεις βιομετρικών συστημάτων απαγορεύονται, για παράδειγμα συστήματα αναγνώρισης συναισθημάτων που χρησιμοποιούνται στο χώρο εργασίας και ορισμένα συστήματα για την κατηγοριοποίηση ατόμων ή απομακρυσμένη βιομετρική ταυτοποίηση σε πραγματικό χρόνο για σκοπούς επιβολής του νόμου σε δημόσια προσβάσιμους χώρους (με στενές εξαιρέσεις).

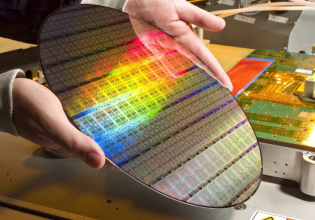

Νέα μοντέλα στην Τεχνητή Νοημοσύνη

Για να συμπληρώσει αυτό το σύστημα, ο νόμος για την τεχνητή νοημοσύνη εισάγει επίσης κανόνες για τα λεγόμενα μοντέλα τεχνητής νοημοσύνης γενικής χρήσης , τα οποία είναι μοντέλα τεχνητής νοημοσύνης υψηλής ικανότητας που έχουν σχεδιαστεί για να εκτελούν μια μεγάλη ποικιλία εργασιών, όπως η δημιουργία κειμένου που μοιάζει με άνθρωπο. Τα μοντέλα τεχνητής νοημοσύνης γενικής χρήσης χρησιμοποιούνται όλο και περισσότερο ως στοιχεία εφαρμογών τεχνητής νοημοσύνης. Ο νόμος για την τεχνητή νοημοσύνη θα διασφαλίσει τη διαφάνεια κατά μήκος της αλυσίδας αξίας και θα αντιμετωπίσει πιθανούς συστημικούς κινδύνους των πιο ικανών μοντέλων.

Εφαρμογή και επιβολή των κανόνων AI

Τα κράτη μέλη έχουν προθεσμία έως τις 2 Αυγούστου 2025 για να ορίσουν εθνικές αρμόδιες αρχές, οι οποίες θα επιβλέπουν την εφαρμογή των κανόνων για τα συστήματα τεχνητής νοημοσύνης και θα διεξάγουν δραστηριότητες εποπτείας της αγοράς. Το Γραφείο τεχνητής νοημοσύνης της Επιτροπής θα είναι ο βασικός φορέας εφαρμογής του νόμου για την τεχνητή νοημοσύνη σε επίπεδο ΕΕ, καθώς και ο επιβολής των κανόνων για τα μοντέλα τεχνητής νοημοσύνης γενικής χρήσης.

Τρία συμβουλευτικά όργανα θα υποστηρίξουν την εφαρμογή των κανόνων.

- Το Ευρωπαϊκό Συμβούλιο Τεχνητής Νοημοσύνης θα διασφαλίσει την ομοιόμορφη εφαρμογή του νόμου για την τεχνητή νοημοσύνη σε όλα τα κράτη μέλη της ΕΕ και θα λειτουργεί ως ο κύριος φορέας συνεργασίας μεταξύ της Επιτροπής και των κρατών μελών.

- Μια επιστημονική ομάδα ανεξάρτητων εμπειρογνωμόνων θα προσφέρει τεχνικές συμβουλές και στοιχεία σχετικά με την επιβολή. Συγκεκριμένα, αυτό το πάνελ μπορεί να εκδίδει ειδοποιήσεις στο Γραφείο AI σχετικά με κινδύνους που σχετίζονται με μοντέλα τεχνητής νοημοσύνης γενικής χρήσης.

- Το Γραφείο Τεχνητής Νοημοσύνης μπορεί επίσης να λάβει καθοδήγηση από ένα συμβουλευτικό φόρουμ , που αποτελείται από ποικίλα ενδιαφερόμενα μέρη.

Τσουχτερά πρόστιμα

Οι εταιρείες που δεν συμμορφώνονται με τους κανόνες θα τιμωρούνται. Τα πρόστιμα θα μπορούσαν να ανέλθουν έως και το 7% του παγκόσμιου ετήσιου κύκλου εργασιών για παραβιάσεις απαγορευμένων εφαρμογών τεχνητής νοημοσύνης, έως και 3% για παραβάσεις άλλων υποχρεώσεων και έως και 1,5% για την παροχή εσφαλμένων πληροφοριών.

Το μεταβατικό στάδιο στην Τεχνητή Νοημοσύνη

Η πλειοψηφία των κανόνων του νόμου για την τεχνητή νοημοσύνη θα αρχίσει να εφαρμόζεται στις 2 Αυγούστου 2026. Ωστόσο, οι απαγορεύσεις συστημάτων τεχνητής νοημοσύνης που θεωρείται ότι παρουσιάζουν απαράδεκτο κίνδυνο θα ισχύουν ήδη μετά από έξι μήνες, ενώ οι κανόνες για τα λεγόμενα μοντέλα τεχνητής νοημοσύνης γενικού σκοπού θα ισχύουν μετά 12 μήνες.

Για να γεφυρωθεί η μεταβατική περίοδος πριν από την πλήρη εφαρμογή, η Επιτροπή δρομολόγησε το Σύμφωνο AI . Αυτή η πρωτοβουλία καλεί τους προγραμματιστές τεχνητής νοημοσύνης να υιοθετήσουν οικειοθελώς βασικές υποχρεώσεις του νόμου περί τεχνητής νοημοσύνης πριν από τις νόμιμες προθεσμίες.

Πηγή: OT.gr

- Γάζα: Συνάντηση στη Φλόριντα για τα επόμενα στάδια της εκεχειρίας – Ο Τραμπ αναμένει και τον Νετανιάχου

- Ο Τραμπ τονίζει πως δεν χρειάζεται έγκριση του Κογκρέσου για να διατάξει πλήγματα στη Βενεζουέλα

- Ουκρανία: Μία νεκρή και εκτεταμένες ζημιές σε ενεργειακές υποδομές από ρωσικές επιδρομές στην Οδησσό

- Στα «ΝΕΑ» της Παρασκευής: Σώθηκαν τα ΕΛΤΑ

- Βουλγαρία: Χιλιάδες πολίτες διαδήλωσαν ενάντια στη διαφθορά – Ζητούν μεταρρύθμιση του δικαστικού συστήματος

- Βενεζουέλα: Προσπάθεια εξαγωγής πετρελαίου κόντρα στον αποκλεισμό των ΗΠΑ